Najmanjši kvadrati

Metoda najmanjših kvadratov je standardni pristop v regresijski analizi za približek rešitve predeterminiranih sistemov (nizov enačb, v katerih je več enačb kot neznank) z minimiziranjem vsote kvadratov rezidualov (rezidual je razlika med opazovano vrednostjo in ocenjeno vrednostjo, ki jo zagotavlja model), narejeno na podlagi rezultata vsake posamezne enačbe.

Najpomembnejša uporaba je pri prilagajanju podatkov. Kadar ima problem precejšnjo negotovost neodvisne spremenljivke (spremenljivka x), se pojavijo težave pri preprostih regresijskih modelih in metodah najmanjših kvadratov. V takih primerih se lahko za problem prilagajanja podatkov namesto metodologije najmanjših kvadratov uporabi metodologijo modelov napak v spremenljivkah.

Problem najmanjših kvadratov se lahko deli v dve kategoriji: linearni ali navadni najmanjši kvadrati in nelinearni najmanjši kvadrati, odvisno od tega, ali so reziduali linearni pri vseh neznankah ali ne. Linearni problem najmanjših kvadratov se pojavlja pri statistični regresijski analizi, kjer obstaja rešitev eksplicitne oblike. Nelinearni problem se običajno reši z iterativnim izboljševanjem, kjer je pri vsaki iteraciji sistem aproksimiran z linearnim, zato je osnovni izračun v obeh primerih podoben.

Opis problema

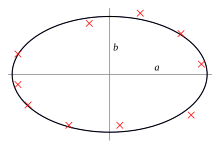

urediCilj je prilagajanje parametrov funkcije modela, da se najbolje prilegajo naboru podatkov. Preprost nabor podatkov je sestavljen iz n točk (parov podatkov) , i = 1, …, n, kjer je neodvisna spremenljivka in odvisna spremenljivka, katere vrednost se ugotovi z opazovanjem. Funkcija modela ima obliko , kjer je v vektorju shranjenih m nastavljivih parametrov . Cilj je najti vrednosti parametrov za model, ki se "najboljše" prilega podatkom. Prileganje modela podatkovni točki se meri z njegovim rezidualom, opredeljenim kot razlika med opazovano vrednostjo odvisne spremenljivke in vrednostjo, ki jo napoveduje model:

-

Reziduali so prikazani z ustreznimi vrednostmi. Naključna nihanja okoli kažejo, da je linearni model primeren.

Metoda najmanjših kvadratov najde optimalne vrednosti parametrov z minimiziranjem vsote kvadratov rezidualov, : [1]

Reševanje problema najmanjših kvadratov

urediNajmanjšo vsoto kvadratov najdemo z enačenjem gradienta z nič. Ker model vsebuje m parametrov, obstaja m gradientnih enačb: in ker postanejo gradientne enačbe Enačbe gradienta veljajo za vse probleme najmanjših kvadratov. Vsak poseben problem zahteva posebne izraze za model in njegove parcialne odvode. [2]

Linearni najmanjši kvadrati

urediRegresijski model je linearen, ko model obsega linearno kombinacijo parametrov, tj. kjer je funkcija odvisna od .[2]

Predpostavimo in nato vstavimo neodvisne in odvisne spremenljivke v matriki in . Najmanjše kvadrate lahko izračunamo na sledeč način. Upoštevajte, da je množica vseh podatkov. [2][3] Gradient kriterijske funkcije je: Gradient kriterijske funkcije enačimo z nič in nato rešimo za in tako dobimo:[2][3]

Sklici

uredi- ↑ A modern introduction to probability and statistics: understanding why and how. Dekking, Michel, 1946-. London: Springer. 2005. ISBN 978-1-85233-896-1. OCLC 262680588.

{{navedi knjigo}}: Vzdrževanje CS1: drugo (povezava) - ↑ 2,0 2,1 2,2 2,3 Williams, Jeffrey H. (Jeffrey Huw), 1956- (november 2016). Quantifying measurement: the tyranny of numbers. Morgan & Claypool Publishers, Institute of Physics (Great Britain). San Rafael [California] (40 Oak Drive, San Rafael, CA, 94903, USA). ISBN 978-1-68174-433-9. OCLC 962422324.

{{navedi knjigo}}: Vzdrževanje CS1: lokacija (povezava) Vzdrževanje CS1: samodejni prevod datuma (povezava) Vzdrževanje CS1: več imen: seznam avtorjev (povezava) - ↑ 3,0 3,1 Rencher, Alvin C.; Christensen, William F. (15. avgust 2012). Methods of Multivariate Analysis (v angleščini). John Wiley & Sons. str. 155. ISBN 978-1-118-39167-9.